2 Strumieniowanie do systemów zewnętrznych

Przegląd

Możliwe jest strumieniowanie wartości pozycji i zdarzeń z Zabbix do zewnętrznych systemów przez HTTP (zobacz szczegóły protokołu).

Filtr tagów może być używany do strumieniowania podzbiorów wartości pozycji lub zdarzeń.

Za strumieniowanie danych odpowiadają dwa typy procesów serwera Zabbix: connector manager i connector worker.

Wewnętrzna pozycja Zabbix zabbix[connector_queue] umożliwia monitorowanie liczby wartości umieszczonych w kolejce connector.

Konfiguracja

Do skonfigurowania strumieniowania danych do systemu zewnętrznego wymagane są następujące kroki:

1. Przygotuj zdalny system do odbierania danych z Zabbix. W tym celu dostępne są następujące narzędzia:

- Przykład prostego odbiornika, który zapisuje odebrane informacje do plików

events.ndjsonihistory.ndjson. - Kafka connector for Zabbix server - lekki serwer napisany w Go, przeznaczony do przekazywania wartości pozycji i zdarzeń z serwera Zabbix do brokera Kafka.

2. Ustaw wymaganą liczbę workerów connectorów w Zabbix, dostosowując parametr StartConnectors w pliku zabbix_server.conf.

Liczba workerów connectorów powinna odpowiadać skonfigurowanej liczbie connectorów w frontend Zabbix (lub ją przekraczać, jeśli liczba sesji współbieżnych jest większa niż 1).

Następnie uruchom ponownie serwer Zabbix.

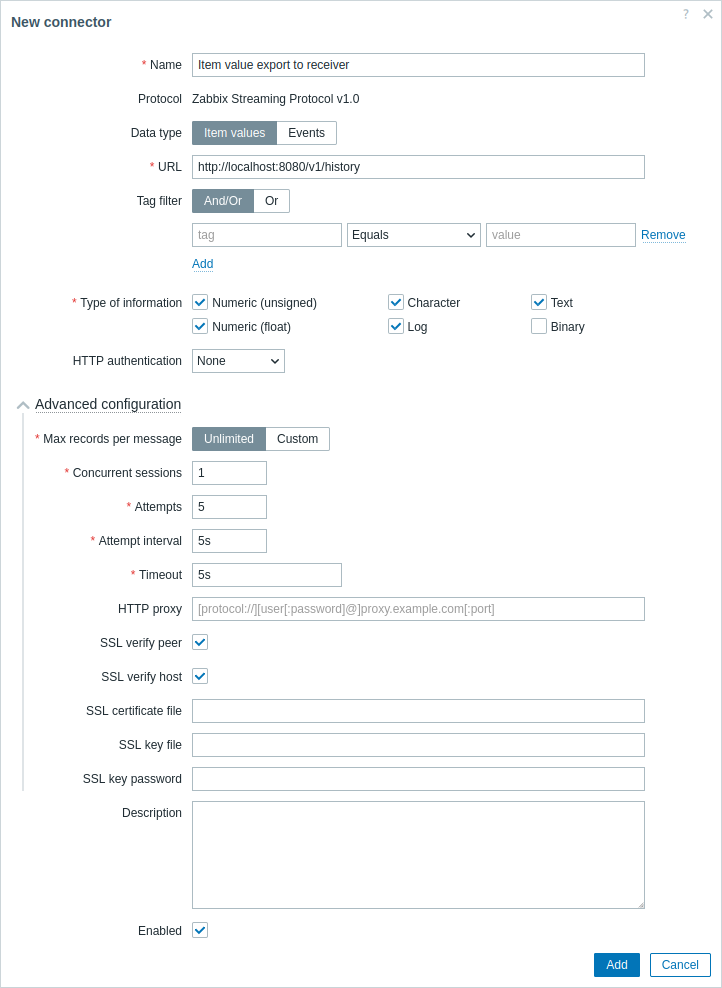

3. Skonfiguruj nowy connector w frontend Zabbix (Administration > General > Connectors) i przeładuj pamięć podręczną serwera poleceniem zabbix_server -R config_cache_reload.

Pola obowiązkowe są oznaczone gwiazdką.

| Parameter | Description |

|---|---|

| Name | Wprowadź nazwę connectora. |

| Data type | Wybierz typ danych do strumieniowania: Item values - strumieniuj wartości pozycji z Zabbix do systemów zewnętrznych; Events - strumieniuj zdarzenia z Zabbix do systemów zewnętrznych. |

| URL | Wprowadź adres URL odbiornika. Obsługiwane są makra użytkownika. |

| Tag filter | Eksportuj tylko wartości pozycji lub zdarzenia pasujące do filtra tagów. Jeśli nie zostanie ustawiony, eksportowane będą wszystkie dane. Można zarówno uwzględniać, jak i wykluczać określone tagi oraz wartości tagów. Można ustawić kilka warunków. Dopasowanie nazwy tagu jest zawsze rozróżniane wielkością liter. Dla każdego warunku dostępne są następujące operatory: Exists - uwzględnij określone nazwy tagów; Equals - uwzględnij określone nazwy tagów i wartości (rozróżniana wielkość liter); Contains - uwzględnij określone nazwy tagów, których wartości tagów zawierają wprowadzony ciąg (dopasowanie podciągu, bez rozróżniania wielkości liter); Does not exist - wyklucz określone nazwy tagów; Does not equal - wyklucz określone nazwy tagów i wartości (rozróżniana wielkość liter); Does not contain - wyklucz określone nazwy tagów, których wartości tagów zawierają wprowadzony ciąg (dopasowanie podciągu, bez rozróżniania wielkości liter). Dostępne są dwa typy obliczania warunków: And/Or - wszystkie warunki muszą zostać spełnione, warunki o tej samej nazwie tagu zostaną pogrupowane według warunku Or; Or - wystarczy, że spełniony będzie jeden warunek. |

| Type of information | Wybierz typ informacji (numeric (unsigned), numeric (float), character itp.), według którego mają być filtrowane wartości pozycji, które connector ma strumieniować. To pole jest dostępne, jeśli Data type ma ustawioną wartość "Item values". |

| HTTP authentication | Wybierz opcję uwierzytelniania: None - bez uwierzytelniania; Basic - używane jest uwierzytelnianie podstawowe; NTLM - używane jest uwierzytelnianie NTLM (Windows NT LAN Manager); Kerberos - używane jest uwierzytelnianie Kerberos (zobacz także: Konfigurowanie Kerberos w Zabbix); Digest - używane jest uwierzytelnianie Digest; Bearer - używane jest uwierzytelnianie Bearer. |

| Username | Wprowadź nazwę użytkownika (do 255 znaków). Obsługiwane są makra użytkownika. To pole jest dostępne, jeśli HTTP authentication ma ustawioną wartość "Basic", "NTLM", "Kerberos" lub "Digest". |

| Password | Wprowadź hasło użytkownika (do 255 znaków). Obsługiwane są makra użytkownika. To pole jest dostępne, jeśli HTTP authentication ma ustawioną wartość "Basic", "NTLM", "Kerberos" lub "Digest". |

| Bearer token | Wprowadź token Bearer. Obsługiwane są makra użytkownika. To pole jest dostępne i wymagane, jeśli HTTP authentication ma ustawioną wartość "Bearer". |

| Advanced configuration | Kliknij nagłówek Advanced configuration, aby wyświetlić zaawansowane opcje konfiguracji (patrz poniżej). |

| Max records per message | Określ maksymalną liczbę wartości lub zdarzeń, które mogą zostać przesłane w jednej wiadomości. |

| Concurrent sessions | Wybierz liczbę procesów wysyłających, które mają być uruchomione dla tego connectora. Można określić do 100 sesji; wartość domyślna to "1". |

| Attempts | Liczba prób strumieniowania danych. Można określić do 5 prób; wartość domyślna to "1". |

| Attempt interval | Określ, jak długo connector ma czekać po nieudanej próbie strumieniowania danych. Można określić do 10 s; wartość domyślna to "5s". To pole jest dostępne, jeśli Attempts ma ustawioną wartość "2" lub większą. Nieudane próby to takie, w których nie udało się nawiązać połączenia lub kod odpowiedzi HTTP nie jest równy 200, 201, 202, 203, 204. Ponowne próby są wyzwalane w przypadku błędów komunikacji lub gdy kod odpowiedzi HTTP nie jest równy 200, 201, 202, 203, 204, 400, 401, 403, 404, 405, 415, 422. Przekierowania są obsługiwane, więc 302 -> 200 jest odpowiedzią pozytywną; natomiast 302 -> 503 spowoduje ponowną próbę. |

| Timeout | Określ limit czasu wiadomości (1-60 sekund, domyślnie - 5 sekund). Obsługiwane są sufiksy czasu, np. 30s, 1m. Obsługiwane są makra użytkownika. |

| HTTP proxy | Możesz określić proxy HTTP w następującym formacie:[protocol://][username[:password]@]proxy.example.com[:port]Obsługiwane są makra użytkownika. Opcjonalny prefiks protocol:// może być użyty do określenia alternatywnych protokołów proxy (obsługa prefiksu protokołu została dodana w cURL 7.21.7). Jeśli nie zostanie określony protokół, proxy będzie traktowane jako proxy HTTP. Domyślnie używany będzie port 1080.Jeśli HTTP proxy jest określone, proxy nadpisze zmienne środowiskowe związane z proxy, takie jak http_proxy, HTTPS_PROXY. Jeśli nie zostanie określone, proxy nie będzie nadpisywać zmiennych środowiskowych związanych z proxy. Wprowadzona wartość jest przekazywana bez zmian, bez sprawdzania poprawności.Możesz również podać adres proxy SOCKS. Jeśli określisz niewłaściwy protokół, connector nie będzie w stanie strumieniować wartości pozycji ani zdarzeń z Zabbix. Pamiętaj, że z proxy HTTP obsługiwane jest tylko proste uwierzytelnianie. |

| SSL verify peer | Zaznacz pole wyboru, aby zweryfikować certyfikat SSL serwera WWW. Certyfikat serwera zostanie automatycznie pobrany z systemowej lokalizacji urzędu certyfikacji (CA). Lokalizację plików CA można zmienić za pomocą parametru konfiguracji serwera Zabbix lub proxy SSLCALocation. |

| SSL verify host | Zaznacz pole wyboru, aby zweryfikować zgodność pola Common Name lub pola Subject Alternate Name certyfikatu SSL serwera WWW. Ustawia to opcję cURL CURLOPT_SSL_VERIFYHOST. |

| SSL certificate file | Nazwa pliku certyfikatu SSL używanego do uwierzytelniania klienta. Plik certyfikatu musi być w formacie PEM1. Obsługiwane są makra użytkownika. Jeśli plik certyfikatu zawiera również klucz prywatny, pozostaw pole SSL key file puste. Jeśli klucz jest zaszyfrowany, podaj hasło w polu SSL key password. Katalog zawierający ten plik jest określany przez parametr konfiguracji serwera Zabbix lub proxy SSLCertLocation. |

| SSL key file | Nazwa pliku prywatnego klucza SSL używanego do uwierzytelniania klienta. Plik klucza prywatnego musi być w formacie PEM1. Obsługiwane są makra użytkownika. Katalog zawierający ten plik jest określany przez parametr konfiguracji serwera Zabbix lub proxy SSLKeyLocation. |

| SSL key password | Hasło pliku prywatnego klucza SSL. Obsługiwane są makra użytkownika. |

| Description | Wprowadź opis connectora. |

| Enabled | Zaznacz pole wyboru, aby włączyć connector. |

Gdy Kafka connector jest skonfigurowany z listą adresów bootstrap brokerów rozdzielonych przecinkami (na przykład Kafka.URL=kafka1.example.com:9093,kafka2.example.com:9093), klient Kafka łączy się z brokerem lub brokerami, które odpowiedzą jako pierwsze, i używa ich metadanych klastra.

Jeśli lista zawiera adresy z różnych klastrów Kafka, użyty zostanie tylko najszybciej odpowiadający klaster, a pozostałe adresy zostaną zapisane w logu jako niedostępne; w rezultacie mogą pojawić się ostrzeżenia podczas uruchamiania, takie jak poniższe, mimo że connector jest połączony:

kafka cluster connected, but broker(s) "kafka1.example.com:9093, kafka2.example.com:9093" unavailable; will retry on message send if active brokers fail W niektórych środowiskach (sieci prywatne, sieci kontenerowe lub niestandardowe konfiguracje DNS/hosts) nazwy hostów lub adresy IP mogą być rozwiązywane do adresów loopback (na przykład 127.0.0.1/localhost) albo normalizowane przez klienta, co może sprawiać, że takie ostrzeżenia będą mylące.

Aby ograniczyć niejasności, upewnij się, że wszystkie adresy Kafka.URL należą do tego samego klastra Kafka, zweryfikuj rozwiązywanie DNS z hosta connectora oraz advertised.listeners brokerów i preferuj adresy, które rozwiązują się do adresu ogłaszanego przez brokera.

Protokół

Komunikacja między serwerem a odbiorcą odbywa się przez HTTP z użyciem REST API, NDJSON, „Content-Type: application/x-ndjson”.

Więcej informacji można znaleźć w protokole eksportu JSON rozdzielanego znakami nowej linii.

Żądanie serwera

Przykład strumieniowania wartości pozycji:

POST /v1/history HTTP/1.1

Host: localhost:8080

Accept: */*

Accept-Encoding: deflate, gzip, br, zstd

Content-Length: 628

Content-Type: application/x-ndjson

{"host":{"host":"Zabbix server","name":"Zabbix server"},"groups":["Zabbix servers"],"item_tags":[{"tag":"foo","value":"test"}],"itemid":44457,"name":"foo","clock":1673454303,"ns":800155804,"value":0,"type":3}

{"host":{"host":"Zabbix server","name":"Zabbix server"},"groups":["Zabbix servers"],"item_tags":[{"tag":"foo","value":"test"}],"itemid":44457,"name":"foo","clock":1673454303,"ns":832290669,"value":1,"type":3}

{"host":{"host":"Zabbix server","name":"Zabbix server"},"groups":["Zabbix servers"],"item_tags":[{"tag":"bar","value":"test"}],"itemid":44458,"name":"bar","clock":1673454303,"ns":867770366,"value":123,"type":3}Przykład strumieniowania zdarzeń:

POST /v1/events HTTP/1.1

Host: localhost:8080

Accept: */*

Accept-Encoding: deflate, gzip, br, zstd

Content-Length: 333

Content-Type: application/x-ndjson

{"clock":1673454303,"ns":800155804,"value":1,"eventid":5,"name":"trigger for foo being 0","severity":0,"hosts":[{"host":"Zabbix server","name":"Zabbix server"}],"groups":["Zabbix servers"],"tags":[{"tag":"foo_trig","value":"test"},{"tag":"foo","value":"test"}]}

{"clock":1673454303,"ns":832290669,"value":0,"eventid":6,"p_eventid":5}Odpowiedź odbiorcy

Odpowiedź składa się z kodu statusu odpowiedzi HTTP oraz ładunku JSON. Kod statusu odpowiedzi HTTP musi mieć wartość "200", "201", "202", "203" lub "204" dla żądań, które zostały obsłużone pomyślnie, inny dla żądań zakończonych niepowodzeniem.

Przykład powodzenia:

HTTP/1.1 200 OK

Content-Type: application/json

X-Content-Type-Options: nosniff

Date: Tue, 21 Apr 2026 10:13:04 GMT

Content-Length: 23

{"response":"success"}Przykład z błędami:

HTTP/1.1 422 Unprocessable Entity

Content-Type: application/json

X-Content-Type-Options: nosniff

Date: Tue, 21 Apr 2026 12:15:01 GMT

Content-Length: 55

{"error":"invalid character '{' after top-level value"}